Les techniques de reconnaissance de la parole progressent, comme le montre le projet RogerVoice, une application pour smartphone qui propose de transcrire la parole en texte en temps réel qui vient de se lancer sur Kickstarter. Mais ce n’est peut-être pas la seule piste.

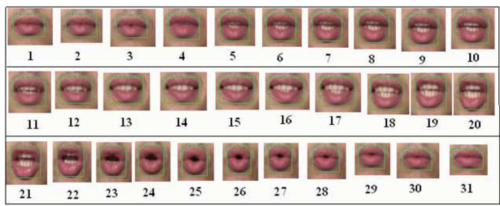

La lecture sur les lèvres est une des pistes envisagées pour améliorer ces techniques, car la lecture labiale améliore la capacité à interpréter la parole, même pour ceux qui n’ont pas de problème d’audition, rappelle Arxiv pour la Technology Review. Pour Ahmad Hassanat de l’université de Mu’tah en Jordanie, si la lecture labiale est en cours d’automatisation, les défis demeurent encore important, car reconnaître une séquence de formes et les faire correspondre à des mots ou des séquences de mots n’est pas si simple. Quand nous parlons, la bouche prend entre 10 et 14 formes différentes (on parle de visèmes), alors que le discours contient environ 50 sons différents (on parle de phonèmes) : un seul visème peut donc représenter plusieurs phonèmes. Ce qui signifie qu’une séquence de visèmes peut avoir plusieurs significations. Autre problème : les lèvres de vos interlocuteurs sont souvent masquées. Au final, même les très bons lecteurs confrontés à des vocabulaires limités ne réussissent à déchiffrer en moyenne que 50 % des mots prononcés.

Les systèmes de lecture sur les lèvres permettent pourtant de faire de progrès, en s’intéressant non seulement aux lèvres, mais à tout le visage, en améliorant la reconnaissance géométrique des lèvres (hauteur, largeur, forme de l’ellipse, rougeur de l’image, le fait que les dents soient visibles ou pas…). Reste que tout le monde n’est pas pareillement expressif avec le mouvement des lèvres, certaines les déplacent très peu. Le système mis au point par Ahmad Hassanat réussit pourtant un taux de reconnaissance de 76 % et est plus élevé encore sur les visages imberbes que sur les visages barbus. Reste que les meilleurs lecteurs humains s’appuient sur d’autres informations pour interpréter la parole : le contexte de la conversation, les mouvements du corps et une bonne connaissance des idiomes parlés. Autant de facteurs que les caméras ont encore du mal à prendre en compte et qui permet d’envisager son amélioration…

Reste que tout cela à un côté obscur. Nos caméras sauront demain transcrire les mots qu’elles voient.

Laisser un commentaire